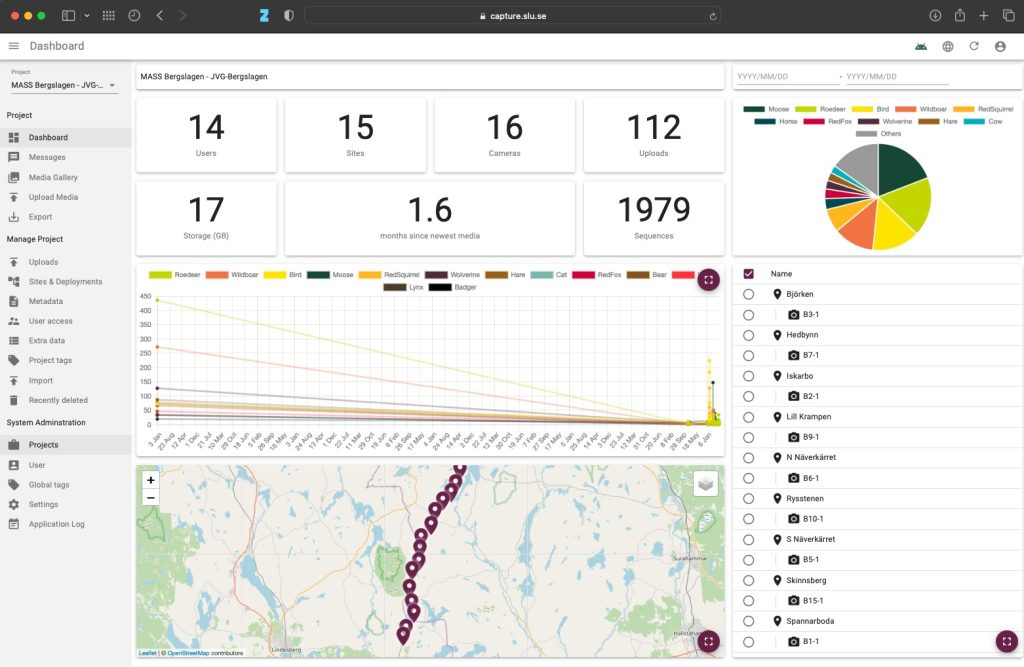

Capture är en ny platform för en effektivare hantering, analys och kategorisering, samt förvaltning av bildmaterial från kamerastudier

Capture erbjuder en centraliserad arkivering av anonymiserad och avpersonifierat bildmaterial. Detta stödjer inte bara korttidsprojekt med autokameror utan även långtidsuppföljningar av miljöförändringar eller djurförekomst. Systemets moduluppbyggnad möjliggör att nya algoritmer för bildigenkänning av annat än vilt och människa kan nyttjas vilket öppnar för nya användningsområden. Plattformens utvecklades genom samarbete mellan SLU, Sweco, och Nina. Projektet finansierades av Trafikverket och Vinnova.

- Se på videon om Capture.

- Se ett kort bildspel om Capture.

- Se Swecos webbsida om Capture.

- Läs mer i utvecklingsprojektets slutrapport.

Sedan december 2021 föreligger Capture i sin första driftversion, och utvecklingen fortskrider kontinuerligt i samarbete med användarna och input från myndigheter för att bemöta deras olika behov och krav på systemet.

Intresserad i att prova Capture? Kontakta andreas.seiler@slu.se om du vill testa ett demo-projekt eller önskar skapa ett eget projektkonto.

Varför Capture ?

Rörelseaktiverade kameror erbjuder en kostnadseffektiv övervakningsmetod (Burton et al. 2015) men eftersom de triggas av förändringar i bildparametrarna, kan inspelningen aktiveras inte bara av djur utan även av människor, fordon, nederbörd, strålkastarljus med mera (Meek et al. 2014). Detta skapar en mycket stor mängd av bilder som är problematiska eller ointressanta i uppföljningssyfte. Förvaltning och granskning av bildmaterialet samt identifiering av relevanta bilder kräver fortfarande ett omfattande manuellt arbete eftersom befintliga tekniska verktyg och mjukvarulösningar (Hamel et al. 2013, Bubnicki et al. 2016, Young, Rode-Margono & Amin 2018) inte är anpassade till verksamheten eller till svenska säkerhetskrav. Liknande behov finns även i andra områden där rörelseaktiverade kameror används (ekologisk forskning, viltförvaltning, Norouzzadeh et al. 2018). Ett första steg mot bildanalysverktyg för dessa ”viltkameror” har gjorts bl.a. med finansiering från Naturvårdsverket (projekt SCANDCAM; se även Hofmeester et al. 2019), men det behövs uppdaterade algoritmer samt bättre gränssnitt och rutiner för bildförvaltning och bildlagring som uppfyller personuppgiftslagstiftningens krav och myndigheternas särskilda behov (se IMY:s nya riktlinjer för kameraanvändning).

Capture utgår från detta och erbjuder en plattform där artificiell intelligens (AI) och maskininlärning (ML) används för att urskilja relevanta bilder och avpersonifiera bilder på människor och fordon. Capture erbjuder också manuell granskning och tagning av bilder, samt import och exportfunktioner. Om Capture ska användas för att ta tillfällig hjälp av AI eller för att kunna långsiktigt förvalta bildmaterial variera mellan projekten. Nya funktioner och resurser kommer att kopplas in efter behov i samråd med projektägare.

Referenser / References

Seiler, A., Jäderkvist, P., Dalheimer, J., & Jansson, C. (2022). Capture – IT-plattform för bildigenkänning och förvaltning. Trafikverket Rapport, 2022:017. http://trafikverket.diva-portal.org/smash/record.jsf?pid=diva2%3A1647741&dswid=-3623

Bubnicki, J.W., Churski, M., Kuijper, D.P.J. & Poisot, T. (2016) Trapper: an open source web-based application to manage camera trapping projects. Methods in Ecology and Evolution, 7, 1209-1216.

Burton, A.C., Neilson, E., Moreira, D., Ladle, A., Steenweg, R., Fisher, J.T., Bayne, E., Boutin, S. & Stephens, P. (2015) Wildlife camera trapping: a review and recommendations for linking surveys to ecological processes. Journal of Applied Ecology, 52, 675-685.

Hamel, S., Killengreen, S.T., Henden, J.-A., Eide, N.E., Roed-Eriksen, L., Ims, R.A., Yoccoz, N.G. & O’Hara, R.B. (2013) Towards good practice guidance in using camera-traps in ecology: influence of sampling design on validity of ecological inferences. Methods in Ecology and Evolution, 4, 105-113.

Hofmeester, T.R., Cromsigt, J., Odden, J., Andren, H., Kindberg, J. & Linnell, J.D.C. (2019) Framing pictures: A conceptual framework to identify and correct for biases in detection probability of camera traps enabling multi-species comparison. Ecol Evol, 9,2320-2336.

Meek, P.D., Ballard, G., Claridge, A., Kays, R., Moseby, K., O’Brien, T., O’Connell, A., Sanderson, J., Swann, D.E., Tobler, M. & Townsend, S. (2014) Recommended guiding principles for reporting on camera trapping research. Biodiversity and Conservation, 23, 2321-2343.

Norouzzadeh, M.S., Nguyen, A., Kosmala, M., Swanson, A., Palmer, M.S., Packer, C. & Clune, J. (2018) Automatically identifying, counting, and describing wild animals in camera-trap images with deep learning. Proc Natl Acad Sci U S A, 115, E5716-E5725.

O’Connell, A.F., Nichols, J.D. & Karanth, K.U. (2011) Camera Traps in Animal Ecology. Methods and Analyses. Springer.

Young, S., Rode-Margono, J. & Amin, R. (2018) Software to facilitate and streamline camera trap data management: A review. Ecol Evol,8, 9947-9957.

SCANDCAM – https://viltkamera.nina.no ; https://www.slu.se/ew-nyheter/2019/5/nya-verktyg-for-viltovervakning/