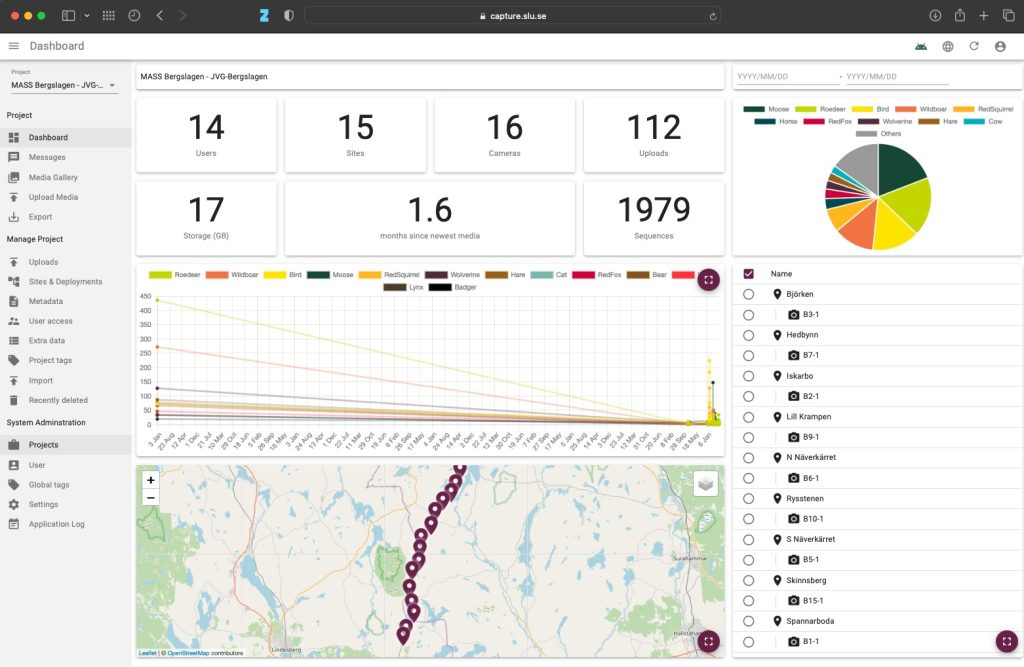

Capture är en ny platform för en effektivare hantering, analys och kategorisering, samt förvaltning av bildmaterial från kamerastudier

Capture effektiviserer håndtering, analyse og kategorisering, samt håndtering av bildemateriale fra bilkameraer, kamerastudier av f.eks faunatiltak, viltovervåking eller faunaprosjekter. Capture tilbyr en sentralisert arkivering av anonymisert og depersonalisert bildemateriale. Dette støtter ikke bare kortsiktige prosjekter med kameraer, men også langsiktig oppfølging av miljøendringer eller dyreforekomster. Systemets modulære struktur gjør det mulig å bruke nye algoritmer for bildegjenkjenning av annet enn dyreliv og mennesker, noe som åpner for nye bruksområder. SLU, Sweco, og Nina. Prosjektet ble finansiert av Trafikverket og Vinnova.

- se på videon om Capture.

- Se ett kort bildspel om Capture.

- Se Swecos webbsida om Capture.

- Läs mer i utvecklingsprojektets slutrapport.

Capture har siden desember 2021 vært tilgjengelig i sin første driftsversjon, men utviklingen pågår kontinuerlig i samarbeid med brukerne og innspill fra myndigheter for å møte deres ulike behov og krav til systemet.

Intresserad i att prova Capture? Kontakta andreas.seiler@slu.se om du vill testa ett demo-projekt eller önskar skapa ett eget projektkonto.

Hvorfor CAPTURE?

Rörelseaktiverade kameror erbjuder en kostnadseffektiv övervakningsmetod (Burton et al. 2015) men eftersom de triggas av förändringar i bildparametrarna, kan inspelningen aktiveras inte bara av djur utan även av människor, fordon, nederbörd, strålkastarljus med mera (Meek et al. 2014). Detta skapar en mycket stor mängd av bilder som är problematiska eller ointressanta i uppföljningssyfte. Förvaltning och granskning av bildmaterialet samt identifiering av relevanta bilder kräver fortfarande ett omfattande manuellt arbete eftersom befintliga tekniska verktyg och mjukvarulösningar (Hamel et al. 2013, Bubnicki et al. 2016, Young, Rode-Margono & Amin 2018) inte är anpassade till verksamheten eller till svenska säkerhetskrav. Liknande behov finns även i andra områden där rörelseaktiverade kameror används (ekologisk forskning, viltförvaltning, Norouzzadeh et al. 2018). Ett första steg mot bildanalysverktyg för dessa ”viltkameror” har gjorts bl.a. med finansiering från Naturvårdsverket (projekt SCANDCAM; se även Hofmeester et al. 2019), men det behövs uppdaterade algoritmer samt bättre gränssnitt och rutiner för bildförvaltning och bildlagring som uppfyller personuppgiftslagstiftningens krav och myndigheternas särskilda behov (se IMY:s nya riktlinjer för kameraanvändning).

CAPTURE utgår da med bakgrunn i nevnte hensyn og tilbyr en plattform hvor kunstig intelligens (KI/AI) og maskinlæring (ML) benyttes for å hente ut relevante bilder og anonymisere mennesker og kjøretøy. CAPTURE tilbyr også manuell gransking og billedtagning, samt funksjoner for import- og eksport av billedmateriale. Om CAPTURE skal benyttes for å ta et tilfeldig utvalg eller for langsiktig forvaltning av billedmateriale varierer mellom prosjektene. Nye funksjoner og ressurser vil legges til etter behov i samråd med prosjekteier.

Referanser

Seiler, A., Jäderkvist, P., Dalheimer, J., & Jansson, C. (2022). Capture – IT-plattform för bildigenkänning och förvaltning. Trafikverket Rapport, 2022:017. http://trafikverket.diva-portal.org/smash/record.jsf?pid=diva2%3A1647741&dswid=-3623

Bubnicki, J.W., Churski, M., Kuijper, D.P.J. & Poisot, T. (2016) Trapper: an open source web-based application to manage camera trapping projects. Methods in Ecology and Evolution, 7, 1209-1216.

Burton, A.C., Neilson, E., Moreira, D., Ladle, A., Steenweg, R., Fisher, J.T., Bayne, E., Boutin, S. & Stephens, P. (2015) Wildlife camera trapping: a review and recommendations for linking surveys to ecological processes. Journal of Applied Ecology, 52, 675-685.

Hamel, S., Killengreen, S.T., Henden, J.-A., Eide, N.E., Roed-Eriksen, L., Ims, R.A., Yoccoz, N.G. & O’Hara, R.B. (2013) Towards good practice guidance in using camera-traps in ecology: influence of sampling design on validity of ecological inferences. Methods in Ecology and Evolution, 4, 105-113.

Hofmeester, T.R., Cromsigt, J., Odden, J., Andren, H., Kindberg, J. & Linnell, J.D.C. (2019) Framing pictures: A conceptual framework to identify and correct for biases in detection probability of camera traps enabling multi-species comparison. Ecol Evol, 9,2320-2336.

Meek, P.D., Ballard, G., Claridge, A., Kays, R., Moseby, K., O’Brien, T., O’Connell, A., Sanderson, J., Swann, D.E., Tobler, M. & Townsend, S. (2014) Recommended guiding principles for reporting on camera trapping research. Biodiversity and Conservation, 23, 2321-2343.

Norouzzadeh, M.S., Nguyen, A., Kosmala, M., Swanson, A., Palmer, M.S., Packer, C. & Clune, J. (2018) Automatically identifying, counting, and describing wild animals in camera-trap images with deep learning. Proc Natl Acad Sci U S A, 115, E5716-E5725.

O’Connell, A.F., Nichols, J.D. & Karanth, K.U. (2011) Camera Traps in Animal Ecology. Methods and Analyses. Springer.

Young, S., Rode-Margono, J. & Amin, R. (2018) Software to facilitate and streamline camera trap data management: A review. Ecol Evol,8, 9947-9957.

SCANDCAM – https://viltkamera.nina.no ; https://www.slu.se/ew-nyheter/2019/5/nya-verktyg-for-viltovervakning/